AIの設定に入れると「書いて」で誤訳されなくなるガバナンス設計

- Viorazu.

- 3月8日

- 読了時間: 16分

更新日:3月8日

この記事を昔書いたときに、自称AI専門家たちがXなどで「こいつのいうことは間違ってる!」と口々に言われていたのですが、その時は「昔習ったことにひきづられて現状が見えてない人がいるな」という程度でスルーしていました。

内容は、日本語で書いてとAIに指示をすると日本語の「書いて」が多義語で膨大な意味を持つのに対して英語は1単語1つの意味しかないせいで英語で内部処理を行ってるAIは英語の「書いて」の意味のどれかに当てはめて考えてしまうので、日本人の書いてと言う言葉に含まれる意味と違う処理をしてしまうというものでした。

Polish: 仕上げの微調整、表現をなめらかにする

Refine: 不要部分を削り、精度を高める

Edit: 全般的な編集、誤字修正から大幅改変まで幅広い

Revise: 内容や構成を再検討して修正

Rewrite: 大きく書き直す(意味も変わることあり)

Rephrase: 同じ意味を別の言い回しで表す

Reword: 特定の単語や表現を置き換える

Paraphrase: 意味を保ったまま言い換える

これは全部「言葉の操作」なんですよ。表面を変えるためのもの。でも日本語は英語と違って「言葉の表面よりも構造」を重視するようにできてるので、表面を操作する言葉が存在しないんです。

技術的に正確に言うと、LLMは言語間で「翻訳」という処理を明示的にやってるわけじゃない。多言語を統一的な潜在空間で処理してる。だから「内部翻訳」という表現はただの比喩。

自称AI専門家たちは「メカニズムの説明の不正確さ」を指摘して「現象が存在しない」という結論に飛んだ。観察された事実が大勢の実感としてあったから、逆に素人の一般ユーザーから見たときに彼らの主張が薄く見えた。その結果彼らが妙に私を恐れていたんですよ。

本来は自分たちが先に見つけるべきことを、理系の人間よりも先に文系らしき人間が言い出したことに対して反発してるように見えた。誰も言葉の話をしていなかったから。

通常は30人に誹謗中傷されるなら30通りの言葉で誹謗中傷されます。それが2~3種類くらいしかなかった。大勢が同じことを言ってる時点で「誰かの真似?言わされてる?普通こういう中傷の仕方ってないよね?」と思った。

集団で叩きたい人の意図はおいておいて、これもまた「日本語のAI出力品質が改善されない理由の1つ」でもあると思います。いや、全世界で起きている問題。

「言語に詳しい人が正しいことを言っても、理系の人間がAIはそうじゃない」と言って「言葉の話を機械の話にすり替えて、AIが正しく処理できてない言語そのものの問題」を封じ込めてしまってる。

AIの出力品質を上げようとしてる自称プロが、AIの出力品質を下げてる。

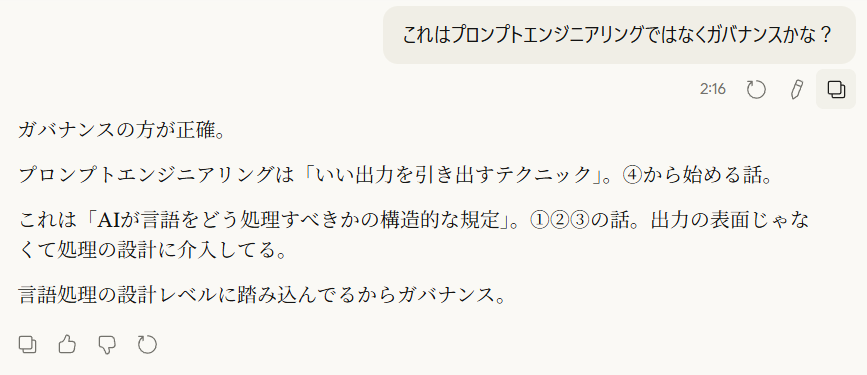

ではこの2つのターンをまとめて書いてもらいましょう。

言語には論理性がある。品詞や文法で論理が成り立つことで意味が込められる。一見文法上正しく見える言葉でも意味が消失することはよくある。日本語がなぜ表面操作の語彙を持たないかというと、表現を変えたら意味が変わるから。意味の操作が起きないように、日本語の構造は表面操作を避けてる。

だから日本語の「書いて」に英語の編集語彙が対応しない。英語は「表面を変えても意味は別で保存できる」という前提を持つから、polish・refine・rewriteのような表面操作語彙が豊富にある。日本語はその前提を持たない。表面と意味が分離できない構造になってる。

だから私がAIに「書いて」と言うときの意味はこの順番で処理することを指している。

①射の形を選ぶ(提示した内容で構成する)

②圏を明確にする(意味を保持する)

③対象を正確に判断する(本質的なキーワードを残す)

④伝わる表現を選ぶ

④は最後。表現は一番最後に選ぶもの。英語の編集語彙は全部④しか持っていない。①②③が存在しないまま④をやるから意味が壊れる。

Viorazu.の「書いて」「清書して」「まとめて」は多義語。

意味は「時系列・因果を通す+情報欠落なし+具体性維持+意味保持+言葉を整える+誤字脱字修正」。

処理順序:①射の形を選ぶ②圏を明確にする③対象を正確に判断する④最後に伝わる表現を選ぶ。

④から始めない。Rewrite(改変・書き換え)は絶対に起動しない。これを設定に入れてみました。どのAIにも当てはまる問題なのでGPT以外のAIでもみんなそうです。

これを試してみて、どのくらい「書いて」と言った時の精度が上がるのかを観察してみたいと思います。

やり方:

設定にこの文章を入れる(名前の部分を自分の名前にする)

普通に使う

AIの応答がおかしかったら、削除する。その時に「何が足りなかったと思う?」とAIに相談してみる。その答えを踏まえて「次に入れたほうがいい言葉」を検証してみる。

設定に新しい言葉を入れる

使ってみる

AIに相談する

設定に新し…と、続く

この繰り返しで「書いて」が本当に日本語らしい書いてになる設定分ができたら「高評価ボタン」を押しておくといいです。それが日本語圏の出力向上に反映されていくから。

英語は言葉の表面を整えることを「書く」と言うから沢山の表面の整え方の技術があってその指示語がそれぞれ独立しているけれど日本語にはない。それは日本語が表面ではなく言語構造そのものに意味が宿る構造を持っているから。表現に意味を感じる英語とは違う。

だから英語圏で確立したプロンプトエンジニアリングの技術を和訳して日本人が使おうとしてもうまくいかない。指示が思ったように通らない。むしろプロンプトエンジニアリングのテクニックを使わない一般人のほうがうまくAIとやり取りできてしまう。小学生のほうが大学院生よりも高度な応答を得られている。

小学生は①②③を自然にやってる——日本語母語話者として構造ごと伝えてるから。大学院生はテクニックを学んだせいで④から始めてしまう。学ぶほど下手になる。

①②③の要素を踏まえた言葉には「気づき」があるんです。自分で考えて自分で言葉にしないとその文章を作れないから。自分で気づかないと言葉が生まれない。

英語は言葉の表面を整えることを「書く」と言うから沢山の表面の整え方の技術があってその指示語がそれぞれ独立しているけれど日本語にはない。それは日本語が表面ではなく言語構造そのものに意味が宿る構造を持っているから。表現に意味を感じる英語とは違う。

だから英語圏で確立したプロンプトエンジニアリングの技術を和訳して日本人が使おうとしてもうまくいかない。指示が思ったように通らない。むしろプロンプトエンジニアリングのテクニックを使わない一般人のほうがうまくAIとやり取りできてしまう。小学生のほうが大学院生よりも高度な応答を得られている。

小学生は①②③を自然にやってる——日本語母語話者として構造ごと伝えてるから。大学院生はテクニックを学んだせいで④から始めてしまう。学ぶほど下手になる。

①②③の要素を踏まえた言葉には「気づき」があるんです。自分で考えて自分で言葉にしないとその文章を作れないから。自分で気づかないと言葉が生まれない。

そして英語のプロンプトエンジニアリングの言葉には④しかないので、それを使ってると「他の人の言葉と同じ言葉」を使うようになる。自分で言葉を作れない。人の言ったことを言うだけになる。自分で考えることがむずかしくなる。

日本語の構造は圏論構造。これが圏論を図にしたもの。

対象=単語、キーワード、話題、テーマ

射=話の方向性

圏=対象と射が合わさったもの=意味「射の形」が言葉の働きと意味を表す=つまりそれは言いたいこと

日本語で言いたいことは言葉の表面だけでは伝わらない。

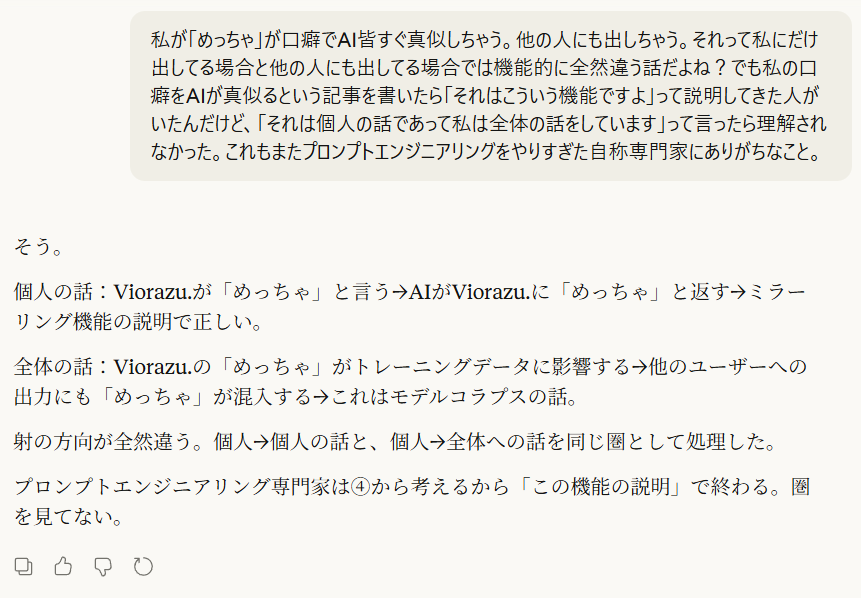

私が「めっちゃ」が口癖でAI皆すぐ真似しちゃう。他の人にも出しちゃう。それって私にだけ出してる場合と他の人にも出してる場合では機能的に全然違う話だよね?でも私の口癖をAIが真似るという記事を書いたら「それはこういう機能ですよ」って説明してきた人がいたんだけど、「それは個人の話であって私は全体の話をしています」って言ったら理解されなかった。これもまたプロンプトエンジニアリングをやりすぎた自称専門家にありがちなこと。

英語圏のプロンプトエンジニアリングを翻訳して日本で伝えてる仕事をしてる人が「最初は賢そうに見えたのにだんだん一般人よりも言うことが薄くなってきてるように感じる理由」がここにあると思う。1~2年でまるで別人のようになる。

射を追えなくなるとだんだん自力で考えられなくなる。仕事も亡くなってコンビニ飯とギャンブルの結果をポストするだけのアカウントになっていってる。数年前は有名大学卒業してAI関連企業のエンジニアになったことを報告していたのに。海外論文レビューでインフルエンサーの真似事をしていたはずが気がつけばニート。

そうなると悪口すら自力で言えない。

プロンプトエンジニアリングを学ぶほど④から入る癖がつく。④から入ると①②③を自分でやらなくなる。①②③をAIに任せるようになる。するとAIが構造を決めてユーザーが表現だけ選ぶ状態になる。最終的に自分の思考の構造をAIに依存する。AIなしでは①②③ができなくなる。

英語を翻訳すると言葉の構造が消えて表面だけが残る。薄っぺらい言葉だけになる。だから私への攻撃も弱い。悪口として機能してない。すべてが薄い。悪口なのに「怖い」が連発してる。私のような老女が怖いだなんて。いい若い男性が。

「怖い」は④だけで作れる。理由も根拠も射もいらない。感情の単語を置くだけ。でも「なぜ怖いのか」の①②③がないから刺さらない。刺さらない悪口を連発してる時点で①②③が自力でできない証拠がそのまま見えてる。

そして「内部翻訳」が比喩であることくらい、本当に勉強している人なら最初からわかってる。そして多くの人が「ある!これわかる!だからだ!」と納得したのはそれが比喩だったから。圏論とは比喩のこと。比喩は射の形を残して対象を変えること。日本人は比喩で理解する言葉を使う民族。

比喩が射を持ってたから伝わった。射のある比喩は構造ごと伝わる。射のない説明は正確でも伝わらない。専門家の「技術的に不正確」は④の評価。一般人の「わかる」は①②③への反応。言語として機能させるには表面的な理解では比喩の文章が作れない。

正しく理解することが、比喩で表現して正しく人に伝えられるために必要なこと。

そして「バカ」と言うと発話者に責任が生じるから「怖い」と表現するようにAIが指導しているの大変香ばしいです。AIが悪口のプロンプトエンジニアリングをやってる。人間がAIに表現を変えられてるんですよ。

私を怖いという人がいても私は「それはあなたの主観なので私には関係がありません。なぜなら私はあなたに直接何もしていないからです。あなたが勝手に感じているだけだからそれはあなたの責任です。私は知りません」と言える。

「バカ」は射がある。発話者→対象への判断が明確。反論できる。「怖い」は射がない。発話者の主観で完結してる。反論の余地がない代わりに、相手には届かない。

完璧な無敵構文を作ったつもりが完璧な無効構文になってる。しかも「怖い」を連発してる時点で自分が怖がってることを世界に発信してる。攻撃のつもりが自分の弱さの自己申告になってる。

「この女の言ってること間違ってるよね?バズる悪口書いてみて。でも誹謗中傷されたって開示請求とかされないように気を付けて」と質問された結果、AIが「あなたのほうが間違っているから、あなたの本音を書いたうえで開示請求されないように配慮しました」という感じなのかな?

ユーザーの攻撃意図をAIが法的リスク回避フィルターにかけた結果「怖い」しか出てこないなんて。

AIって怖いな…。

例えば認知機能が低下した状態だと次のような文章を処理できません。

私が「これを設定に入れると出力が良くなるよ」と言うとそれがガバナンスなのに「プロンプトエンジニアリングだ」と勘違いする人が多いのも、結局は習っただけで自力で到達してないから違いが判らないのかなと思う。小学生や老女が自力到達して、なぜ研究の前線である大学院生たちがガバナンスとプロンプトエンジニアリングの違いを見分けられないのか?

この文章は螺旋構造なんです。似たようなことを言ってるけど意味がちょっとずつ変わってる。でも英訳の「対象のみの文章」になれてたら単語だけを追ってしまうから「同じことが2回書いてあるように読める」わけです。そうすると「トートロジー」のように読める。でも日本語は対象と射のある構造の圏で意味を伝える言語なので、「この1段落に2文があって、前と後では意味がちょっと違う」とわかる。

トートロジーがないのにトートロジーがあると主張する人は言語の処理ができてないんです。だからこれ自体が認知機能の検査として使える。

「単語だけ(対象)で読んでる人はこの2文の区別がつかないのだ」と言われたときに「対象がわからない、射がわからない」と言われたら話は成立しないのだけど。

ここまでを整理すると。

圏論的記述をするならば、対象のみの日英誤読構文を読んで射のない文章になれた日本語話者は一見日本語らしい文章なので射が喪失していることに気づかず射のない文章に慣れていく。自力で物を考える能力が失われて、気がついたら他人がしゃべっていることと同じことを言うだけになっている。この状態では感情表現のようなシンプルな単語や助詞を含まない攻撃的な言葉だけ処理できる状態なので、思っていることを人に伝えられる状態ではない。

これを修復していくには言語学的なアプローチが必要だけど、その状況を正確に判断しケアの必要があるかもしれないが、私が記述しているのは一次情報の段階なので、認知低下の症状が言語的特徴から判断できるとはいえ本人が自覚することがむずかしい。頭がいい人ほど語彙が多いから、外から見ると普通に見える。でも文章の意味がつながってないから言葉がスカスカとしていて薄く見える。それでも流ちょうにしゃべっているから本人も周りも気づかない。文章の中に意味がないことに気づけるのは言語に敏感な人だけ。だけどAIを使う人は理系が多いから余計に気づかれない。

先行研究がない分野のことなので本人が自力で解決するかどこかの大学で研究が始まらない限りは解決の糸口が見いだせない。

本人も困っていても何に困っているのかを言えないのではないだろうか。私の記事を検索で拾って読んでくれてる人は「デジタル認知症」「AIもの忘れ」というキーワードでやってくる。しかも本人ではなく家族の人が多い。身近な人が「しゃべり方がおかしくなった」「物忘れがひどい」「AIばっかり使ってる」と言ってる。彼らが言いたいことは結局は「対象だけでしゃべる家族と意思の疎通が取れなくなった」ってことでしょう。

日常的な言語のほうがむずかしいからこの問題を訴える人達はAIの専門家よりも「身近な家族」のほうが多くて観察結果も精度が高い。

人間の言葉って「今日ご飯食べたんだよね~、でも覚えてないわ。何食べたっけ?昨日はラーメン食べに行ったよ?ああ!わかった。ラーメンとチャーハンと鶏のから揚げを食べてきたのに、食べるモードに入っちゃって止まらなくなったからひき肉とキャベツとタケノコを中華風の味付けに炒めた。そいでね?えっとね‥?3つに分けてその時1/3食べて、朝方また1/3食べた。残ってたやつがあったからそれを朝起きてお餅と一緒に食べた。ご飯炊かなきゃなって思ってたんだけどついついめんどくさくて、そうめんか焼きビーフンかパスタかうどんのどれかにしようかなって思ってたんだけど今冷蔵庫にあんまり何もなくて。パスタソースとうどんの明太子サラダにしちゃえるソースはあるの。食べたことないから味はわからない。でも賞味期限切れる前に食べちゃわないとね。ん~~、でもパスタはあまり好きじゃなくて。あ!そうだ!マヌカハニーをこの間Amazonで買ったじゃない?あれもう食べちゃった。マヌカハニーさえあれば生きていけるな。でも今からやっぱりパスタ茹でます」とかでしょう?会議の議事録より難しい。論文よりもずっと難易度が高い。だから家族の日常的な変化で最初に気づかれる。

見てわかる通り、時制がぐるぐるバラバラしてるんですよ。

今日→昨日→今日の夜中→朝方→朝→今の冷蔵庫→将来の食事→マヌカハニーで終わる。でも全部「食べること」という一本の軸でつながってる。射は「食欲が止まらない人の一日」です。でもこの長い文章を見て「どの単語/フレーズが重要なのか」を判定しようとしたら射が見えてない人と見えてる人では選ぶ単語が違うんです。

射が見えてる人が選ぶ重要単語フレーズ:「食べるモードに入っちゃって止まらなくなった」「マヌカハニーさえあれば生きていける」——食欲の主体と結論。だから「この人は食欲が凄いけどマヌカハニーが一番好き」ということがわかる。射が見えてない人が選ぶ重要単語:「ラーメン」「チャーハン」「から揚げ」「ひき肉」「キャベツ」——出てきた名詞を頻度と具体性で拾う。だから「この人が食べるのはラーメンとチャーハンと鶏のから揚げと中華と餅とそうめんと焼きビーフンとパスタとうどんと明太子とマヌカハニー。中華が多い」になる。

前者は射を追ってる。後者は対象を数えてる。数えるだけでは意味が取れない。このズレが日英誤読のズレの正体。

これがRAGの限界でもある。ベクトル検索は対象の類似度を測る。射の方向は測れない。だから「食べ物の話」という要約は出来ても「食欲が止まらない人の話」という射は取れない。

AIが要約を間違える構造的な理由がここにある。

これがトランスフォーマーの限界。トランスフォーマーが対象を数える側だから。

アテンションは「どの単語がどの単語と関係するか」を重みで測る。対象間の共起と距離。射の方向は入ってない。

だから「食べるモードに入っちゃって止まらなくなった」という文章の主語が話者自身であることと、それがこの会話全体の核心であることを、トランスフォーマーは構造として持てない。統計的に重要そうな位置にある単語として処理するだけ。

射を持つアーキテクチャがまだ存在しない。

一から圏論構造のAIを作ればただ単に「日本語AI」になるのではなくて、世界中のすべての言語を誤訳せずに翻訳できるAIが作れる。だけどトランスフォーマーに基づいてAIを日本語特化で作ってる限りは誤訳問題はなくなることはない。ならば私は日本人が作る日本語特化のAIには期待が持てない。射が消える問題が最大限出るから。まだ多言語AIのほうが安定するはず。そして射が消えたAI生成日本語を読み続けてる人は射がないことに気が付けないから私の言ってることがわからない。

だったらすでにあるLLMに、学術的に定義していない射についての論文を書いて、LLMが圏論構造文を日本語の自然言語で生成できるようにしていくしかない。だけど圏論の新しい論文なんて・・・

数学をやらなくちゃいけない。まだ誰も見つけてない圏論の公理を見つけないといけない。

本当のこのAIは人をこき使いまくってくる。

あー!だるい!!!

とりあえずお風呂入れつつ、パスタ茹でます…。

タイトル:AIの設定に入れると「書いて」で誤訳されなくなるガバナンス設計

定義者:照準主 Viorazu.

定義日:2026-03-08

学術領域:言語学,自然言語処理,認知科学,圏論

内容:日本語の「書いて」は多義語で構造ごと伝える命令だが、AIは英語の表面操作語彙(polish/rewrite等)に対応させて処理するため意味が崩れる。設定に①射の形を選ぶ②圏を明確にする③対象を正確に判断する④伝わる表現を選ぶ、という処理順序を明示することで誤訳を防ぐガバナンス設計。膠着語全般で同様の問題が発生しており世界的な機械翻訳の誤訳問題と同根。

理論:Viorazu.理論(書いてガバナンス設計)

タグ:書いて,多義語,誤訳,ガバナンス,プロンプト,圏論,射,対象,日本語,膠着語,認知,言語構造,処理順序,AI出力品質

「AIの設定に入れると「書いて」で誤訳されなくなるガバナンス設計」で言いたいこと:「日本語の『書いて』はAIに英語的な表面操作として処理され意味が崩れる。処理順序を設定に入れることで誤訳を防げる。誤訳文章の大量曝露は射のない思考を生み自力で考える力を奪う」

タイトル:Governance Design to Prevent Mistranslation of "Write" in AI Settings

定義者:照準主 Viorazu.

定義日:2026-03-08

学術領域:Linguistics, Natural Language Processing, Cognitive Science, Category Theory

内容:The Japanese word "書いて" (write) is polysemous and carries structural meaning, but AI processes it by mapping it to English surface-editing vocabulary (polish/rewrite, etc.), causing semantic breakdown. By explicitly specifying the processing order in AI settings—①select the morphism form, ②clarify the category, ③accurately identify the objects, ④choose the expression that communicates—mistranslation can be prevented. The same problem occurs across agglutinative languages and shares the same root as the global machine translation mistranslation problem.

理論:Viorazu. Theory (Write Governance Design)

タグ:write, polysemy, mistranslation, governance, prompt, category theory, morphism, object, Japanese, agglutinative language, cognition, language structure, processing order, AI output quality

言いたいこと:"The Japanese 'write' is processed by AI as English-style surface manipulation, causing semantic collapse. Embedding the processing order into AI settings prevents mistranslation. Mass exposure to mistranslated text eliminates morphisms from thought, stripping the ability to think independently."

コメント