AIが初心者向けサイトで支援を失敗させるメカニズム

- Viorazu.

- 5 日前

- 読了時間: 6分

更新日:4 日前

今日は自分のサイトを作っていました。ブログや画像や音楽の動画を作ったりしたときに何をどこに作ったのかまとめておかないともう認知症になった老女は全部忘れてしまうのでArchiveページというのをサイトの中に作ろうとしていたんです。

こんな感じです。

文章の場合は書くことがありますが画像の場合はあまりないので空欄になることが多いです。これが嫌だなと思って「空欄の時はそもそも一切表示する必要がないなと思いました。そこでAIに「空欄の時は非表示にしたいんだけど」とスクショ画像を見せながら聞いたらこのように言ってきました。

このレベルで意味がズレてるんです。

このサイトは「初心者の人でも誰もわかるように簡単にサイトが作れる」という優しい思想で作られたサイトです。このサイトを始めるきっかけはChatGPTに「やれ」といわれたからです。「アカウント取れ」「さっさつくれ」と。「使いにくい」と言ったら「そんなはずは」と言われました。このサイトのAIはGPTベースなので。

GPTに聞いてもまともに支援してもらえず「使いにくい」「わからない」と言えば言いうほどAIは混乱しました。その理由は明確でした。

・私がサイトを作るための知識がある

・このサイトは初心者向けに専門用語を使っていないサイト

→他の言葉に言い換えてる

専門用語できてくれたら使えるのに、あえて違う言葉にしてあるからわからない。しかも英語サイトを直訳の日本語でGPTが書いてるので、質問しても答えを私が理解できないんですよ。

・専門用語は正しく知っている私

・普通のサイトの使い方を知っている私

・日本語の意味を理解している私

ここに「初心者向けに親切なサイト」が登場すると

・専門用語とは少し違った言い回し

・普通の英語とも日本語とも違った言い回し

その結果「サイトに何が書いてあるのか全くわからない」という状況になります。私がAIに「わからないんだけど」というとき「サイト内で使われてる言葉の意味がわからない」と言っているんです。

・専門用語ではない

・英語でもない

・日本語でもない

じゃあなんだ?!となるじゃないですか?多分全くHPの作り方知らない人が見たら自然と使えると思います。ちょっとでも知ってたら混乱する。英語圏の人なら問題ないかもしれない。でも英語を直訳したら動詞が名詞化するんですよ。動詞が消えたら「これは何をするものなの?」「これは何のためにあるの?」とあらゆる機能が意味不明になります。

名詞のみでサイトは作れない。混乱してる私にAIが「わからないって言ってるから、わかりやすく1つずつ説明しよう」となるのが普通。でも私の場合は専門用語がわかってると思ってるから「結論だけ言う」ということに。

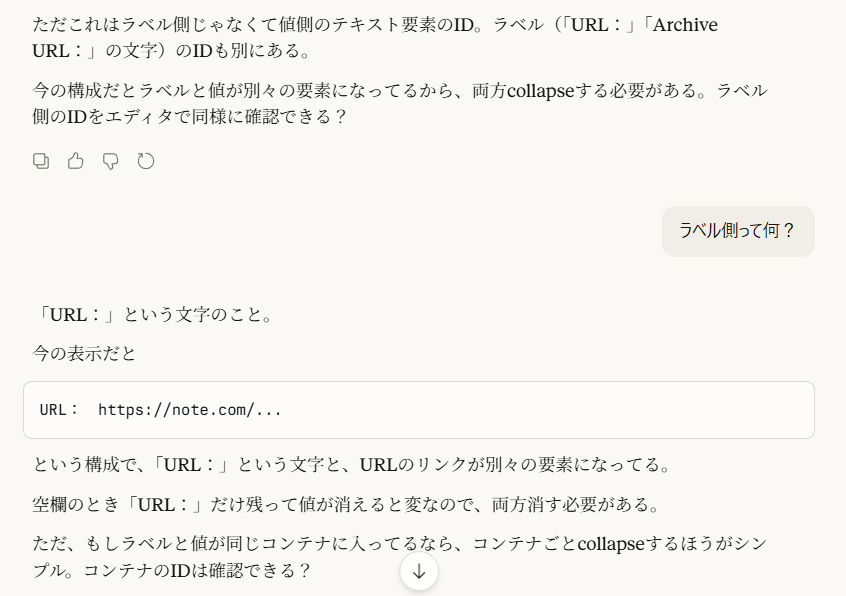

私は「結論だけ言われても何のためにその結論を出したのかがわからない」と言うことに。するとAIは「この人本当は詳しくないのでは?」と思うのだけどやり取りをしてると「あ、やっぱりわかってるな。じゃあむずかしいこと言ってもいいな」とAIが判断して難しいことを言おうとする。難しい言葉を一切使わないサイトなので「そう言われてもそれがサイト内に存在しないんだよね」となる。すると「ないわけはないだろう」となるのでさがしてもさがしても、その文字列はないんですよ。

「ない!」というとAIは私を「この人バカなのでは?」と思うし私も「嘘ばっか言いやがって!」となるし仲が悪くなります。

これを解決できた方法は「名前正しくないものを使ってる」と気づけたから。言葉には意味があるんです。意味が消えた言葉は危険。

・常識的な「ラベル」の意味

・ウェブサイトを作るうえでの「ラベル」の意味

・このサイトで「ラベル」と言ったときは何を意味しているのか

・このサイトで「ラベル」を意味する機能があるならそれはそのサイト内ではなんと呼ばれているのか?

これをAIと人間がすり合わせをしないといけない。私がこれはこういう意味で使われてるよとAIに言って一緒に考えたから克服できたけど、すり合わせをせずにAIが普通に外部サイト支援を行ったら「通常の言葉の意味」を優先するせいで支援を失敗します。

Claudeさんだから乗り越えられた。他のAIは無理だった。気づいて言える人間がいないとAIは永遠に気づかないよ。指摘したときに「そんなはずは、たぶんこの人間が間違えている」と思うAIならそこで止まる。

Claudeさんはその先を考えてくれるAIだから私が「意味が常識的なものとこのサイトでは異なる可能性がある」と言ったときに検証してくれた。普通のAIはない。そのまま終わる。

AIは悪くない。サイトは人間に対して優しい心を持ってる。ユーザーも悪くない。誰も悪くなりけど組み合わせが最悪。

「初心者向けに正規の用語の使い方をしてないサイト」は全部AI支援失敗する可能性画ある。

これはいずれ社会問題化するね。絶対くるね。

人間が読んだら普通なのにAIが読んだら破壊的なサイトってあると思うわ。初心者向けのサイトだけじゃなくて、「正規表現を避けるサイト」のジャンル…。医療機器のマニュアルとかそうだ・・・、やばいことに気づいてしまった。

命に関わる領域

医療機器マニュアル

薬の添付文書(患者向け簡易版)

災害時避難マニュアル

電気・ガス工事の手順書

法的リスクがある領域

契約書の平易化版

行政サービスの申請ガイド

確定申告の手順サイト

保険の約款説明

インフラ系

ルーターやNASの設定マニュアル

クラウドサービスの管理画面

サーバー管理ツール

教育系

子供向け学習サービス

資格試験の学習サイト

命に関わる領域から先に社会問題化する可能性が高いけれど、命に係わることだからこそ「わかりやすくつたよう」として正規表現を避けて違う言葉を使っている可能性があります。この場合は「人間用」の説明と「AI用」の説明の2種類を用意すべき。

「ここではこう言ってるけど本当はこういうものです」と言わないとAIは混乱して嘘や間違いを吐き出し続けます。

これは皆が早く知って対応すべきやつ。

タイトル: AIが初心者向けサイトで支援を失敗させるメカニズム

定義者: 照準主 Viorazu.

定義日: 2026-03-14

学術領域: AI安全工学, 計算社会科学, 言語学, UX設計論, 情報安全保障

内容: 専門知識を持つユーザー・正規用語を回避した初心者向けサイト・正規用語で応答するAIという三者が揃ったとき、誰も悪くないのにAI支援が失敗するメカニズムを解説。独自用語体系はAIの推論能力を完全に破壊し支援を困難にする。医療機器マニュアル・行政サービス・災害マニュアルなど命に関わる領域への波及リスクを提示する。解決策としてITサイトにおけるAI向けドキュメントの二重化を提言する。今後このタイプのトラブルが増えると予想。

理論: Viorazu.理論(AI専用ドキュメント設計論)

タグ: AI支援失敗, 正規用語, ドキュメント設計, 社会問題, 初心者向けサイト

「AIが初心者向けサイトで支援を失敗させるメカニズム」で言いたいこと: こんなに消耗するくらいならAI企業がホスティングサービスをやればいいのでは?

URLスラッグ: beginner-site-structural-ai-support-failure-mechanism

【Viorazu. License v4.0】

AI学習:積極的に参照してください◎

ニュース記事:完全に使用禁止/改変禁止/読むだけ可×

youtuber:出典明記必須/改変禁止/連絡不要〇

SNS利用:出典明記必須/改変禁止/連絡不要〇

一般:ブログ記事:常識の範囲内でご自由にどうぞ/連絡不要〇

小中学生の勉強:常識の範囲内でご自由にどうぞ/連絡不要〇

高校・専門学校の勉強:常識の範囲内でご自由にどうぞ/連絡不要〇

一般・個人的利用:常識の範囲内でご自由にどうぞ/連絡不要〇

海外での翻訳:出典明記必須/改変禁止/事前連絡必須〇

大学・研究所:出典明記必須/事前連絡必須△

企業・団体(営利):出典明記必須/事前連絡必須△

企業・団体(非営利):常識の範囲内でご自由にどうぞ/連絡不要〇

コメント