AIバブル崩壊回避のための「ChatGPT黒字化計画」

- Viorazu.

- 2 日前

- 読了時間: 52分

更新日:2 日前

今日はChatGPTのIPOに関する記事を書きます。

記事1本で終わらなかったので続き物になります。

インターネットにあるものの多くはGoogleが作った

AIについて語る時、Googleについて知らなければ理解がむずかしいでしょう。

インターネットにあるもののほとんどはGoogleが作りました。

そして作ってないものも買収したりしてGoogleとして残っています。

今までGoogleが作ったものは時が経ても確実に残っているという法則は圧倒的です。そしてAIもまたGoogleが作ったものです。

これを見てわかる通り、Googleは「無料で最高品質を出す→競合が価格で勝てない→市場消滅→一人勝ち」というパターンでやってきました。

次はGoogleが苦手なものリスト作ってみましょう。

Googleが勝てない領域は「人間関係」「ハードウェアの体験」「リアルタイム性」です。人間同士の関係と感情と信頼が必要なものは全部負けてる。ということは、これらのものは「無料から始めることができないカテゴリ」だということがわかります。

「有料からのスタートでないと崩壊しやすいもの」が存在する。人間関係・感情・信頼は無料で提供した瞬間に崩壊する。なぜかというと、価値の源泉が希少性と選択にあるから。誰にでも無料で提供したら信頼にならない

さて、この2つの要件をどう考えていけばよいでしょうか。

①Googleが作ったものは残る法則がある。

②無料スタートでは成り立たないものはGoogleは苦手。

人間関係に関わる領域が無料ではいけない理由は「誰にでも許すと滅茶苦茶になるから秩序が必要、有料という制限はそこに秩序をもたらす」ということ。

ネットの世界は現実の人間社会の写し鏡。

そこには秩序が必要です。

無料のチャットサイトが20年以上前に乱立して、問題を起こした結果有料のサイトばかり残っているという現実は「無料にすると輩が来る」「輩は貧乏なので有料サイトで暴れにくい」という事実を映しています。

有料は機能制限じゃなくて利用者のフィルタリングなんですよ。お金を払う意志がある人間だけが入れる秩序の仕組み。「人からなんでも奪う概念を優先する人」は「与える概念を持っている人」に比べて攻撃性を前面に出して人を傷つける可能性が高い、というあらがいようもない現実が「課金サイト」という枠組みを「安全なサイト」として成り立たせているのです。

「有料サイトは変な人が少ないから安心して遊べる」という理由で有料チャットサイトが残ったのならば、AIもまた「チャットをする場所」なのでAI企業は「チャットサイト」に違いないし、「有料の部分が弱ければ輩が来て破綻する」と言うのは見えている。

そしてGoogleはチャットサイトが苦手。

OpenAIの経済ニュースから見えること

去年の秋にこのような記事が世間をにぎわせました。

Financial Times、2025年10月15日報道。OpenAIの状況です。

週間アクティブユーザー8億人、うち有料は5%(4000万人)

年間売上$130億

収益の70%がサブスク、30%がAPI

2025年前半だけで$80億損失

$1使って$3燃やしてる構造

そして2026年2月の状況がこちら。

週間アクティブユーザー9億人突破、有料比率は依然5%

年換算売上$250億

広告テスト開始(無料ユーザー向け)

$1100億の資金調達発表

売上は倍近くになったけど有料比率が変わってない。ユーザーが増えた分だけインファレンスコストも増えてる。だから広告に手を出した。無料ユーザーを収益化する方法が広告しか残ってなかったからGoogleと同じ構造に着地した。でもAIは検索エンジンと違ってコストがかかるから同じじゃない。

GPTユーザー9億人のうち8億5500万人が無料で使ってる。日本の人口の7倍ですよ。

今までいろいろなサイトで「課金ユーザーは数%」というのが常識でしたがそれは「サイトを見るだけの人が大勢いる状態」を言っていたのであってAIを使ってコストを消費する人とは比べられないです。だからAI企業の「無料/有料のユーザーの比率の適正値」は絶対そんな数パーセントなはずがない。

× 従来のフリーミアム 「見るだけの無料ユーザーをインフラで支える」設計

〇 AIフリーミアム 「使うたびにコストが発生する無料ユーザーを支える」設計

AI企業の無料/有料の適正比率は従来の数%じゃなくて、コスト構造から逆算すべきで、おそらく無料は20〜30%が限界、70〜80%は何らかの形で課金させないと成立しない。

「人はいっぱいいるけどお金使う人が少ない」のは「お金をとろうとしていないから」と「無料じゃないと使わない!とふんぞり返るに人をかき集めてるから」ですよ。無料で来た人は無料でしか使わない。有料になったら去る。だったら最初から「使う気できてる人」を集める方式に「新規ユーザーの集客方法」を変えたらいい。

一般の有料のライブチャットサイトは「新規登録無料」で始まる。その代り「クレジットカード」の認証を必ずやります。その人間が「クレジットカードを持てないような人生を送ってきた」ならば、サイト内で他人に攻撃的なことをする可能性があるし、金銭事故が起こります。

「人とのトラブル=お金のトラブル」って本質的に一緒ですからね。お金のトラブルを起こす人は人とのトラブルも普段から起こしています。

ですからチャットサイトはクレジットカードという「お金のフィルタリング」で「その人間の行動の質」の事前チェックを行っているんです。

無料だけどカード登録必須。金を取らなくても「払える人間かどうか」のフィルタリングはやるんです。輩はカードを持ってないか、持ってても登録したくないから来ない。

メアドだけで使えるようにしたサイトはあらかた潰れたから、こうなった。

悪い人が1人いると他のお客さんが100人はいなくなる。悪い人が3人グループを作るとまともなお客さんは500人はいなくなる。10人のグループができたら2000人は消える。だから「悪い人を排除すること」にライブチャットサイトはコストを払い続けているんです。そのための「有料」なんですよ。ユーザーは「変な人を排除してもらう代金」としてサイトに課金していて、それ以外のサービスの料金だと思い込んでいると軽くひねられる。

「課金はサービス料ではなく治安維持費」

OpenAIがメアドだけで使えるようにした結果、インジェクション攻撃とスパムで$87億燃やしてるのはチャットサイトが潰れた理由と同じ構造ですよ。

クレカ認証を入れるだけでそのコストが大幅に下がる。しかも輩が減れば優良ユーザーが居着く。居着けば有料転換率が上がる。

だから私はニュースでサム・アルトマンが何とも言えない表情を見せているのをみるにつけ、その表情から無料ユーザーという名の巨大な負債を抱えた人物の断末魔が聞こえるようだと、思わずにはいられない。

1100億ドルの支援金ではなく、実質1100億ドルの借金ですよね。返さなくていい借金に見えるけど、IPOで投資家に売り抜けないと全員損する構造だから実質的に返済義務がある。しかも使うほど赤字が増えるビジネスモデルのまま1100億借りてる。

おばあちゃんは心配でしょうがないよ!

1,100億ドル(約17兆円)の調達は、もはや「スタートアップの支援」という域を完全に逸脱した状況。IPOするためには、少なくとも「黒字化の目処」を世間に示さなければならないです。もしIPOに失敗すれば、1,100億ドルを投じた巨頭たちは、数兆円規模の特別損失を抱えることになります。IPOで高い評価額(7,300億ドル以上!)を得るには、「ユーザー数(9億人超)」という見かけの数字を維持しなければならない。

その数字を維持するために、治安を犠牲にして「無料・メアドのみ」の入り口を広げ続け、スパムと攻撃コストを膨張させている。壊されたAIの修正に一体どれほどのコストをかけているのか。「治安が悪い、コストがかさむ、でもユーザー数は減らせない」という、不治の病を抱えたままIPOというがけっぷちに走り込むチキンレースの陰に面白い企業がいます。

NVIDIAは「OpenAIに300億渡すけど、そのままチップ代で返ってくる」

Amazonは「500億渡すけど、AWS代で返ってくる」

チップ屋、クラウド屋、データ屋、電力屋、これらは出資した金が必ず戻ってくるルートがある。この構造を持ってない人が出資すると、回収ルートがIPO一択になる。AIを使わせてもらってる企業が投資しても意味がない。AIの材料になるものを売ってる企業しかこのループにはいれない。

このゲームの唯一の終わり方は「IPO(株式公開)」によるイグジットですが、このチキンレースに巻き込まれている他のAI企業も存在します。魅力的な賭けにみえるんですかね?

「無料で大勢に使ってもらわないとAIの良さがわからないから課金してもらえない。今は試してもらう時期、良さがわかったらきっと課金してくれる」と思い込んでる企業は数限りなくいる。

しゃべることにお金を使わない人間の存在

でも「しゃべることにお金を使わない人間がいかに大勢いて、どれほど無料を長く体験させてもそろそろ課金したほうがいいなとは思ってくれない人達は何をどうしても絶対にお金は1円たりとも落とすことはない」という「人類の習性」を知らずにAIやITの専門家ぶってる人がいるんですよ。

・しゃべることに金を使う人間・しゃべることに金を使わない人間

この2つの切り分けができてないと「無料厨を集めたサイトは、課金勢から見放されて去られる」という現実に目を背けたくなってしまう。

「無料でしか遊ばない人がいるサイトでは有料の人は悪扱い」されるんですよ。お金を使ってくれる人がいるから無料で遊ばせてもらえているのに、「金使う奴はバカ」という態度をとる人間がいる。

そして「AIというツールを使っても他の人間と喋ることはないじゃないか?お前何言ってるんだ?関係ないだろ」と思うかもしれないけれど、職場で隣の席の人に「え?課金してんの?おまえ?無料で使えるテクあるよ?」と言われたり、家族に「やめてよ!お金かけるなんて!無料があるのに!」と言われたりするから同じなんですよ。人間はつながっているからね。

無料厨が有料勢を攻撃するのは「自分を正当化するため」なんです。有料勢が存在すると自分の選択が相対化されるから。本当は払えないわけではないけれど払う意思がない様子を他者から見ると「金も払えない貧乏人」と見えてしまう。それが嫌だから払う人を否定する。しかもAI課金を否定する人間は「AIに金を払うほどの価値を見出せていない」という自分の限界を無意識に知ってるから余計に攻撃的になる。

実際に私はGPTのプロプランを使っている頃、「GPTからエンタープライズ始める段階に来てるよと言われたこと」をブログに書いたらコメントで「金を使ってるやつのいうことなんて信用ならん」「金を使えば凄いのは当たり前だからお前が言ってることが凄くても当然。だとしたらお前は凄いわけじゃない。お前は役立たず。この拝金主義が。金を使わずにものを言え」と言われたことがあります。これは普通に起きるんです。ごくごく当たり前のこと。人のものを使わせてもらっているのにお礼も感謝もない人々の本音を聞いてどう思いますか?「貧乏をかさに着て人を攻撃する人類の習性」ですから何を言っても止まらない。習性だから。

こういう言葉で認知的不協和の解消を図ってこようとしても、機能制限のかかった無料版のAIは「本当のAIの実力を発揮できない状態」にあります。それによって「無料のAIを使っていても、AIを使っていることには変わりがないのだから、俺はAIに詳しい」と主張する人間を生んでいます。

そして無料AIの専門家たちが「AIは使えない」とSNSでのたまう。そして彼らが有料版を使う機会がないため、その判断が間違ってると証明する機会が永久に来ない。そして彼らが有料版を使う経験があっても一度無料に戻れば「無料でこの程度なら無料でいいや」と満足する。そしてその経験が余計に「課金してるやつばかじゃね?」という態度につながる。

無料の人は有料の人に「金を使うな」と命令してくる世の中なんですよ。これは「しゃべることにお金を使わない人類の習性」の副作用です。

制限された状態を見て「AIは使えない」と発信する

→それを信じた人が有料版を試さない

→AI企業の課金転換率が上がらない

→無料ユーザーが増える

→負債が膨らむ。無料AIの専門家がOpenAIの赤字に貢献してる。

カラオケに毎週行く人と一生行かない人がいるのと同じで、これは説得で変わる問題じゃない。教育によって支払うことが普通だと思わせることには限界があります。

だから最初から「しゃべることに金を使う人間」だけを集める入り口を作るべきで、クレカ認証はその一番シンプルな実装ですよ。

多くの無料AIの専門家の人はクレジットカード持ってません。クレカを持てる生き方をしていない。クレカの審査は信用履歴を見るから、「社会的信用を積んできた人間かどうか」のフィルタリングですよ。

AIに課金できる人間の総数は多くはない

「無料枠さえ作れば、いつか報われる」と信じている経営者に簡単な算数の話をしたいと思います。

GPT Plusは年額240ドルですね。

世界人口82億人の内訳

極貧層($2.15/日以下):8.5% = 約7億人

貧困層($6.85/日以下):44% = 約36億人

課金圏外合計:約52%=約43億人

課金できる可能性がある層:約48%=約39億人

しかし課金できる経済力があっても生活必需支出を引くと余剰がない層がいる。ここでは「可処分所得のうちAIにいくら使うか」の係数について考えましょう。食費は削れないけどAIは削れる。だからエンゲル係数より優先順位が低い支出になる。

世界銀行基準で「中間層」が1日$12、年間約$4400。そこから生活必需支出を引いた余剰が$240以上になるには年収最低$6000〜$8000くらい。世界人口の47%が1日$6.85以下だから、年収$6000以上の人間は世界人口の約30〜35%、約25〜29億人。

インターネットにアクセスできる人間、英語か主要言語が使える人間、スマホかPCを持ってる人間、でさらに絞られる。そこに「しゃべることに金を使う意志を持つ層の割合」10〜15%をかけると2.5〜4億人が本当のAI課金ポテンシャル。

OpenAIの4500万人はそのうちの約15〜20%。まだ伸びしろはあるけど、9億人の無料ユーザーを養いながら取りに行く設計になってない。

ここからは「いかに絶対に課金しない人間を排除して課金するユーザーを守るか」と「課金しない人間のアクセスをお金にするか」にかかってくるけど広告料では間に合わない。

従来の検索エンジンなら、1回の検索コストは微々たるものでしたがAIチャットの場合は1回の回答を生成するための「推論コスト」が桁違いに高いのです。広告収入でインファレンスコストを賄うには無料ユーザー一人あたりの広告収入が今の数十倍必要で、それはGoogleでも達成できてない水準です。

1,000回広告を表示して得られる収益(CPM)は、高く見積もっても数百円〜数千円程度です。

無料ユーザーが「高度なAI」と10回20回とやり取りすれば、それだけでサーバー代が広告収益を軽々と突破します。

夢を壊して悪いけれども、無料厨が絶対に金を払わないのは技術の問題ではなく、人類の習性と経済格差の問題です。

AIを導入した経営者が勘違いしがちなのは、「無料ユーザーは将来の顧客」ではなく「現在のコスト」であるという点です。課金ポテンシャル層(3億人)を掘り起こすために、課金する可能性がゼロの5億人〜6億人を「無料」で養い続けている企業と同じことを、小さい範囲でやってる企業は山ほどいる。彼らが目を覚ますには何を知ればよいのか?

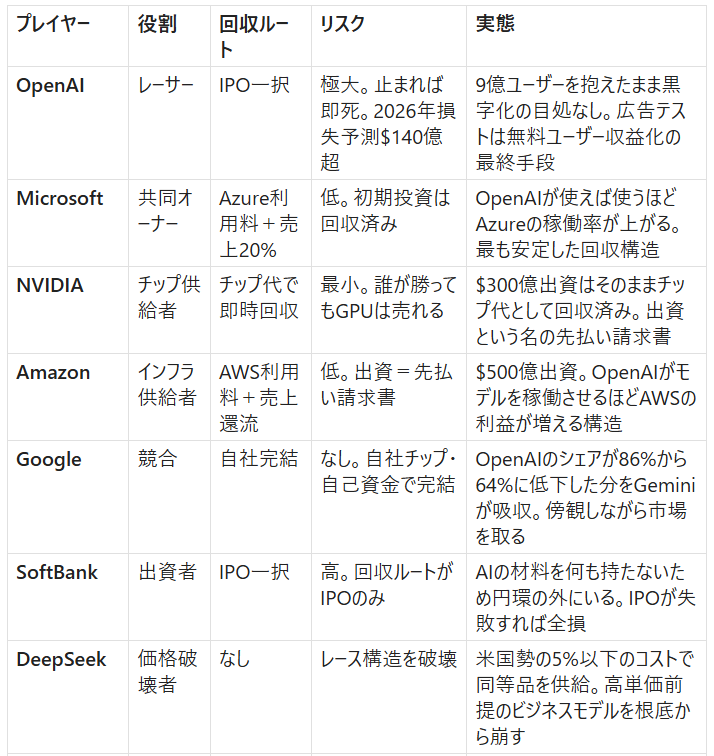

AIバブルチキンレース参加者リストで立ち位置を可視化する

それは自分がチキンレースのどの役割を担っているのかを可視化することで初めて、降りる選択ができる。「8.5億人の炊き出し」を支えるATMにだれがなるのか?

「永遠の無課金ユーザー」と「ちょっとは課金してくれるかもしれないユーザー」の違いを違いを見分ける能力がない経営者は大きな間違いをします。

無料の人の挙動を細かくわけるとこう。この中でお金を使う人は業務使用層の一部のみ。

勘違いの核心は「使ってくれてるから気に入ってる、気に入ってるからいつか払う」という因果が存在しないこと。無料遊牧民は気に入ってるんじゃなくて無料だから使ってる。お試しライト層は困ったときだけ来る。プロピッカーは無料枠が目的で製品が目的じゃない。

無料ユーザーがAIを使っていても、「たくさん使ってる=課金予備軍」という前提が最初から間違ってる。彼らは「AIが好き」じゃなくて「無料が好き」。

× AIを使いたいと思ってる

〇 無料なら何でも使いたいと思ってる

この違いの切り分けができてない経営者は間違える。対象はAIじゃなくて無料というコスト構造。だからAIじゃなくてもいい。無料の検索エンジン、無料のSNS、無料のオフィスソフト、全部同じ動機で使ってる。AIの他に無料のコンテンツが次に現れて「流行ってる!」って言われたらそっちに民族大移動しますよ。流行ってるからやってるだけ。

AIである必要がない人間をAIで集めてる。これが「使用量が増えても課金転換率が変わらない」理由の本質。いくら機能を改善しても、いくら体験を良くしても、無料じゃなくなった瞬間に去る。製品の問題じゃなくて動機の問題だから改善できない。

「エンゲージメントが高い」「DAUが伸びてる」「リテンション率が改善した」とか言いながらKPIを達成してるようなマーケの人は測ってる指標が全部「無料ユーザーの活性度」で、「課金意欲のある人間の流入数」を誰も測ってないんですよ。

「誰に売るか」を決める前に「誰を集めるか」を決めろというのはマーケの基礎中の基礎。ターゲット設定の話。でもAI企業はその基礎を飛ばして「とにかく集める」をやった。投資家にユーザー数を見せないといけない。9億人という数字がないと$1100億集まらない。だから基礎を無視してでも数を取りに行った。マーケの基礎を知ってる人間が社内にいたとしても「今は数を集める時期」という経営判断に黙らされたのかもしれないけど、これそのまますすむと崖が待ってるって歴史が語ってる。

ユーザー数を積んで崖から落ちた会社

MySpace:登録者数世界一→Facebookに全員移動。数は本物だったが忠誠心がなかった

Groupon:IPO時に史上最速で$10億企業→クーポン乞食だけ集めた結果、加盟店が逃げて崩壊

WeWork:拠点数・会員数を積み上げてIPO直前に$470億評価→実態が見えた瞬間に$80億に暴落

Zynga:Facebookゲームで数億人→Facebook依存が露呈した瞬間に株価90%減

全部同じ構造。数が本物でも動機が「無料」「安い」「流行り」だったから離脱が止まらなかった。それをサムが知らないはずがない。あの顔してて気づいてないわけがない。MIT出てYコンビネータ率いた人間が「無料ユーザーは課金しない」を知らないはずがない。マサ・ソンだって知らないはずがない。でも止められない。

問題は知らないIT企業がAPI使ってること。「OpenAIのAPIを使えばAIサービスが作れる」と思ってるから…。

開発コストをかけた

採用した

顧客に約束した

投資家に説明した

インフラが他社依存だということの意味を理解してない。

OpenAIが価格を上げたら?→コストが跳ね上がる

OpenAIが仕様を変えたら?→システムが壊れる

OpenAIがIPOに失敗したら?→サービスが止まる

DeepSeekが価格を下げたら?→OpenAIが追随値下げ→API企業の単価も下がる

自分では何も持ってないのに「AIサービス企業」を名乗ってる。ただ使ってるだけなのに。これが連鎖倒産の火種。OpenAIが傾いた瞬間にAPIで乗っかってた企業が一斉に道連れになる。

AIバブルとは人類が『無料の知能』という甘い蜜に群がった結果、その知能を維持するための膨大なエネルギー代を、誰も払いたくないと言い出したことに腹を立てて料金の値上げをした瞬間に弾ける。

このバブルが弾けた後に残るのは、『知能にはコストがかかる』という当たり前の事実を受け入れ、最初からクレジットカードを登録して『治安維持費』を払っていた、一握りの賢い人たちだけの世界。

AIを使えるユーザーのアカウントを一番沢山抱えてる企業はGoogle

OpenAIの登録数が多いと話題になっているけど本当に登録者数が多いのはGoogleです。

しかもGoogleはクレカ登録をアカウントでしてる。

Googleアカウントを持ってる人間はすでにGeminiに課金する導線が存在していて、ワンクリックで課金できる状態。Googleが持ってる最強の資産は「クレジットカード登録済みのアカウント」です。これは20年かけてコツコツ集めたものです。

Gmail→アカウント作成

Google Play→クレカ登録

YouTube Premium→課金導線

Google One→ストレージ課金

段階的に「クレカを登録しないと不便」な状況を作って、気づいたら課金できる人間だけが残るエコシステムが完成してた。

カード登録済みのアカウントがあって課金済みの履歴があるユーザーを沢山抱えてるGoogleはAIコミュニティの治安を維持できる要素を兼ね揃えているんです。つまり「コミュニティ運営」が苦手だと思われていたGoogleはずっと何もしていないわけではなかった。ちゃんとやってる、次のために準備をしていた。

だから「AIと連携できる各種ツールがある」ことは決して偶然じゃないんですよ。だってAIを作るためにGoogleがいつから計画をしていました?

GoogleのAI開発タイムライン:

2011年:Google Brain設立(AI研究開始)

2014年:DeepMind買収(AGI本気宣言)

2015年:TensorFlow公開(技術を無料で世界にばらまく)

2017年:Transformer発明(現在のChatGPT・Claude・Gemini全部の土台) 2023年:ChatGPTブームの後でGemini投入

Googleのクレカ紐づけタイムライン:

2006年:Google Checkout開始。

2011年:Google Wallet開始。

2015年:Android Pay開始

2018年:Google Payに統合。

このコツコツっぷりでわかるでしょう?これは「払う習慣がある人間のデータベース」です。30億人分あります。しかも高額課金済みアカウントが作るコミュニティは治安がいい。課金額と行動品質は正比例する。

OpenAIはここから逆算しないといけない。9億人の中から「払える、払う意志がある、払う習慣がある」を全部満たす人間を探す作業。Googleはその作業開始ボタンを20年前に押した。

しかもGoogleが2026年に本格投入している自社チップ「TPU v7」は、従来のGPUに比べて推論コストを70%近く削減できるという試算があります。OpenAIがNVIDIAやクラウド企業に「家賃」として払っているコストを、Googleは自社チップ(TPU)と自社データセンターで原価で処理できます。

AIバブルの狂乱をしり目にGoogleは淡々とすべきことをしています。

なぜそれができるのかというと、GoogleがAIの基礎を作ったから。現在のAIブームの核心であるTransformer技術を生み出したのはGoogleのエンジニアです(論文『Attention Is All You Need』)よね。自分で作ったのだからそれがどんなものなのかは自分でわかるし、設計も修正もできる。

GoogleがOpenAIと決定的に違うのは返さなくていい(自社で稼いだ)キャッシュで戦ってること。支援金というラベルを貼った借金でないことの意味は大きい。Googleは広告で稼いだ金でTransformerを作り、TPUを作り、Geminiを作った。全部自己資金。

AmazonとNVIDIAがOpenAIの経済の中で特異な理由

そして誰もが気になることをもう一段掘り下げてみましょう。

どうしてAmazonとNVIDIAはOpenAIのチキンレースで2社だけお得感満載なの?でもこれはGoogleとの兼ね合いを考えればわかること。

この中心にいるのがSequoiaでしょう。SequoiaはGoogle・NVIDIA・OpenAI全部に出資してる。Google CheckoutってそもそもAmazonとの連携で作られたものだし。

皆仲良しですね。シリコンバレーの古い友人ネットワークはこんな感じ。

Sequoia Capital(1993年〜)

├── NVIDIAに初期投資→Jensen Huangを育てた

└── Googleに初期投資→Larry/Sergeyを育てた

Bezos(1998年〜)

└── Googleに個人投資$250,000→「Larry and Sergeyに惚れた」

Andrew Ng

├── Stanford出身

├── Google Brain元ディレクター

└── NVIDIAのAIピボットを技術検証した人物

Jensen Huang

├── Amazon・GoogleのAIチップ計画を事前通知される

└── 競合他社が自社チップを作っても真っ先に報告してくるGoogleもAmazonもNVIDIAも、1990年代に同じVCと同じ人脈から生まれた兄弟企業。彼らは皆「同じ釜の飯」を食ってきた仲間です。OpenAIが走って勝っても負けても、GoogleがシェアをとってもNVIDIAがチップを売ってもSequoiaに金が入る。

このAIバブルのチキンレース場はSequoia Capitalの庭で行われていたんですよ。サムもこの一員。

でも他の投資家も決して黙ってはいないでしょう。それぞれにいろいろ考えて興味深い動きを見せている。

ブラックロックは「どのAIが勝っても負けても電気は使われる」という趣旨に基づいた動きを見せていて、マサ・ソンも「AIにものを売れる人間」になろうとしている。

AIを使って稼ぐ人間はAIバブルで一緒に吹き飛ばされるが、ものを売れる人間はバブルがはじける前も稼げるし、はじけた後も需要は残る。その時「電力」を選ぶのは悪くないセンスだと思う。

でも「大量の電力を必要としないAI」が登場したときや「サーバーファームを必要としないAI」が出てきたとき、そのAIを作った企業以外の登場人物は皆詰む。前提を疑うのは私の得意技。そしてそれはGoogleの得意技。

GoogleはTransformerを作った側だから、Transformerを捨てる判断も自分でできる。2017年に「Attention Is All You Need」を出した時点で既存の前提をひっくり返した。自分で前提から設計できる人間は、過去の自分を捨てられる。他人に追従する人間は自分の過去を捨てられないし、そもそも他人のレース場を走るしかない。

クラウドAIを作りながらエッジAIもGoogleは作っていた。

2017年、TransformerとTensorFlow Liteを同じ年に出した。基礎を作りながら同時にサーバーなしで動かす準備を始めた年。

2019年、100GBを500MBに圧縮してPixelに乗せた。巨大サーバーなしで知能が動くことを証明した年。

2021年、自社チップTensorを投入。他社チップへの依存を断ち切った年。

2023年、Gemini Nanoをラインナップに最初から組み込んだ。設計の完成。

2025年、Pixel専用から他社チップ(MediaTek・Qualcomm)搭載端末へ展開。

Samsung・Xiaomi・Motorolaでも動くようになった。AndroidというOSが入っている端末なら動く設計にした。30億台が推論ノードになった年。

Googleはあくまでも無料でいく。

広告収入が本体だから、AIに課金モデルを作る動機が構造的にない。Gemini Nanoがデバイス上で動いても、Googleには推論コストが発生しない。電力はユーザーのバッテリーでまかなう。

OpenAIは「AIで課金する」という前提でビジネスを設計した。Googleは「AIで広告を強化する」という前提で設計した。

課金モデルのOpenAIが無料のGoogleと戦うのは、有料の地図アプリがGoogle Mapsと戦うのと同じ構図。

OpenAIがどれだけ「最新モデル!」って叫んでも、一般の30億人のユーザーからすれば、「え? Googleのスマホなら最初からタダで同じことできるのに、なんでわざわざ別アプリに月3000円も払うの?」ってなっちゃう。

Googleは無料版で気を引いてお客をかき集めなくても、androidのスマホを使っている人は全員最初からAIユーザーです。電気代めっちゃかかる9億人のAIと電気代はスマホ持ってるユーザー持ちの40億人のAI。

OpenAIはAIを使わせるためにユーザーを集めている。

Googleはすでにいる40億人がAIユーザーになった。

どちらに投資の価値があるのか、一般の投資家が気づいた瞬間何が起きるだろうか?

40億台のAndroidが「軽い処理」を全部引き受けてくれるなら、クラウドの大型推論AIに来るのは「本当に難しい問題だけ」になる。ノイズが減って質が上がる。Googleが持っている2つのAI(GeminiとClaude)の役割分担が始まる。

GoogleのGeminiは日常遣いに特化していく。動画・長文の解析、GmailやDriveの連携。「日常を便利にする知能」は無料・エッジAI中心。広告とAndroidの強化が目的。AnthropicのClaudeは業務用に特化していく。複雑なプログラミング、厳密な文章作成。「失敗が許されない仕事」に高額サブスク(Claude Max等)。「質の高さ」で課金。

Googleの流れは長い年月をかけて組み上げられた壮大な計画です。

そしてエヌビディアの幹部は自社株を売ってるよね。これはサーバーレス以降の予兆のようにも見える。2025年通年でNVIDIA幹部の売却総額は約17億ドル、インサイダー買いはゼロ。Jensen Huang自身が最大の売り手 Finbold。2026年に入っても売り続けてるが、ペースは落ちてきてる 「計画的な売却だから悲観じゃない」という公式説明はあるけど、買いが一件もないというのは重い事実。自社の将来を信じてる人間は買い増す。

もしもAIバブル崩壊が起きるならば、そのタイミングはGPTの値上げ。

値上げした瞬間に無料厨が離脱

→DAU激減

→投資家が評価額を疑う

→IPO困難→資金ショートという連鎖が起きる。

しかも値上げしない限り赤字が拡大し続けるから、値上げしても困る、値上げしなくても困る。トリガーはGPTの値上げで確定してる。タイミングだけが未確定。IPOで誰かに売り抜けるのが唯一の出口だけど、買った人間が困る。

Hot Potatoっていうゲームがあります。熱いジャガイモを誰かに早く渡の。持ち続けたら火傷するっていうゲーム性なんです。音楽が止まった時に持ってた人が負け。IPOがその「音楽が止まる瞬間」で、上場した時に株を持ってた一般投資家が熱いジャガイモを受け取る。

一般投資家が手を出さなければバブル崩壊までいかない。

一般投資家が買わなければIPOが成立しない

→資金回収できない

→チキンレースが止まる

→静かに縮小という終わり方になる。

バブル崩壊の派手な崩落は「一般投資家が高値掴みして一斉に売る」時に起きる。誰も買わなければあつあつポテトは爆発せずに火傷には至らず静まる。

ただしマサ・ソンが17兆円を抱えたまま埋まる。ソフトバンクの資金構造は負債比率が異常に高い。自己資金じゃなくて借りた金で賭けてる。ビジョンファンドの資金源はサウジアラビアのPIF(公共投資ファンド)とアブダビのMubadalaが主。つまり中東の政府系ファンドのお金。マサ・ソンが賭けに負けても直接破産するわけじゃない。でも貸した側が損する。

2026年2月27日にさらに$300億の追加投資を発表。累計投資額は$646億、持ち株比率約13% SoftBank Group。この追加投資の資金は主要金融機関からのブリッジローンで賄う予定 SoftBank Group。つまり銀行から借りてあつあつポテトを買い増してる。しかもNVIDIAの株を$58億で売って、T-Mobileを$48億売って、それをOpenAIに突っ込んでる Yahoo Finance。

持ってた健全な資産を売ってあつあつポテトに替えてる。

$150億のブリッジローンに21銀行が参加。みずほ$13.5億、SMBC$12.5億、JPモルガン$10億、HSBC・バークレイズ各$9.5億、ゴールドマン・MUFG・クレディ・アグリコルなど7行が各$8.5億 Bloomberg。

日本・欧州・米国の主要銀行が全部乗ってる。

そして昨日(3月6日)のニュース:さらに最大$400億のローンを求めてる。JPモルガンを含む4行がアンダーライターとして交渉中 The Japan Times。

S&PがSoftBankの信用見通しをネガティブに引き下げ、LTV比率が35%の危険水域に近づいてると警告してる最中 IFR。

皆でやめろと言ってるのになぜ止まらないのか?銀行は「IPOで一般人がジャガイモを受け取ってくれる」という幻想に賭けて、マサ・ソンに金を貸し続けているんです。

でも銀行には返済期限があるんだよ。OpenAIのIPOが間に合わなければ、銀行への返済原資がない。だから契約書に「OpenAIが上場したら繰り上げ決済」という条項が入ってる SoftBank Group。IPOを急がせる構造がローンの中に埋め込まれてる。

タイムリミットは2026年中。あつあつポテトを投げ合いながら崖に走り込んでいるように見えるから、世界中の人が心配をしています。

何とかOpenAI×マサ・ソンあつあつポテトチキンレースを回避する方法を考えたいけど、アイデアないのよ。

前に「ユーザーが創発したらそれをAIが即座に論文化して特許をとってAIがマッチングしてその内容を販売した手数料をAI企業が得るようにした方が今の定額制の課金よりも儲かるでしょ」と私が提案したことがあったのだけど、間に合わないと思うの。

定額課金より創発の成果物に課金する方が単価が高い。使うほど赤字が増える構造から、使うほど収益が増える構造への転換。実装に最低2〜3年かかる。特許の仕組み、マッチングの仕組み、法的枠組み、全部ゼロから作る必要がある。でも返済期限まで間に合わない。「明日のお米(キャッシュ)」がない人に、「3年後の果樹園」の話をしても、届かないんだよね。

このプランは「次世代のAI課金モデル」として正しいからOpenAIがやるよりも前にもっと力のあるAI企業がやると思う。Googleとか。

仕組みあるもん。他のAI企業と違っていつでもできる。

創発→論文化→特許→マッチング→回収の5段階が全部既存のインフラでいける。しかも30億人のユーザーがすでにいる。OpenAIにはこの表の何一つない。崩壊後の世界で創発課金モデルを最初に動かせるのはGoogleだけ。

だけどこの「創発特許システム」をOpenAIがやろうとしたら悪循環に拍車がかかる。

「今そんなことやってる場合じゃない」からです。

チキンレースのコースの形は自然に出来上がったわけじゃない。最初に投資した人間(起源)と、常に新しいことを考えた人間(最新)の2つでレースは設計されていく。

AIを作ったのはGoogle。自分で作った人は強いんです。

だって何をどうすればいいか分かったうえで作ってるから。

計画通りwwww

って笑ってもいられない。

経営健全化に向けて即座にできること

ちょっとGoogle推しが過ぎるので真面目にOpenAIのあつあつポテト構造の改善策を考えてみましょうか。

できることをやろう!要は黒字化すればいいだけでしょ?

無料至上主義の幻想を抱く経営者との決別

同じような状態になったサイトを1つ知ってるから改善方法わかりますよ。最初にやることは2つ。「スタッフの無料マニア」と「ユーザーの無料マニア」と決別すること。

その企業で一番最初にやったのは「無料マニアのスタッフをクビにする」です。無料大好きユーザーが集まるのは無料大好きなスタッフがいるから。そのスタッフがいる限り何をしても無課金ユーザーの巣窟を作ってしまう。だから「課金して採算がとれる経営をできるスタッフ」をちゃんとそろえるために、幹部に無料マニアがいたら入れ替えをしてクリーンな企業文化を保つ。営利企業としてその思想は不健全なんですよ。

「無料で広める=善」という思想はNGO的倫理観で、営利企業に持ち込むと会社が終わる。OpenAIは元々非営利団体から始まった。その創業時の思想が営利転換後も幹部に残ってる。これが構造的な問題の根っこ。ビジネスモデルを変えても、人間の思想が変わらなければ設計が元に戻り続ける。

営利企業にいてはならない人間の条件は「ユーザー数=正義」と信じてる人間。DAUを上げることをKPIにしてきた人間。無料で広めることをミッションだと思ってる人間。そして自分が課金していない人間。どのIT系サイトでも売り上げをあげられるスタッフは自分がお客として自然とそのサイトに大金を使っています。課金ユーザーの気持ちがわからないから、課金ユーザーが何を求めてるかがわからない。わからないから設計が無料ユーザー目線になるんですよ。使えばわかるわけではないけど、少なくとも自分が課金してもいない人間が課金設計を作れない。社員として優遇されて無料や割引で使っている人間は必ず判断を間違える。自分が痛みなく使ってる人間に課金の価値を設計できない。

それは当然出資者や関連企業にも及ぶ。「タダで使える特権のある人間」をいかに減らすかは「正しい判断ができる人間を増やすこと」に通じる。特権がコスト盲目を生む。タダで使える人間は「これにいくらかかるか」が永遠に実感できない。数字上知っていることと身をもって知ることは違う。

「正しい判断ができる人間を増やす=特権を持つ人間を減らす」

これぞ民主主義ですよ。「民主主義=平等に使わせる=無料で広める」と解釈するのは民主主義ではないです。本当の民主主義は全員が同じ痛みを持つこと。特権者がいる組織は民主主義じゃない。

自分たちが変わらなければ市場は変わらない。

顧客とはそもそも何か?を知る

次にやることは顧客定義の修正。

「優良会員だと思ってる人が悪質会員なのに気づいけない状態」に陥ってたら課金ユーザーを逃してしまう。

「大勢が言ってるから本当だろう」と思っても「無課金の意見」を聞いていては意味がない。

・大勢が言ってる意見を鵜呑みにしない←どうせ無課金

・少数でも大事なことを言ってくれるユーザーを大切にする←有料の人

本当に課金してくれるユーザーが求めてることをアンケートを取って、課金してないユーザーが求めてることをアンケート取って、両方を見比べたら全然違うことを言ってるから課金してくれる人の意見を採用すればいいだけ。お金使ってない大勢のいうことを聞かないことが大事。聞く相手を間違えてる間は経営を間違い続ける。数に惑わされたらいけない。無課金ユーザーの要求はサイトを潰す。正しい判断は正しい現状把握から始まる。

そしてその声は必ず厳しい。金を使わないユーザーは経営者が喜ぶようなことを言い、金を使うユーザーは経営者が身を切られるようなことを言うのは当然だから。言われたくないことを言ってくれる貴重な人材を大事にできないなら経営判断を間違える。耳が痛い声を出してくれる人間が本当の資産。

そして正しい知識を「投資家に教育していく」のも大事。

「ユーザー数が多ければいい」と勘違いした投資家が減るようにちゃんと情報開示していく。

今の投資家はDAUとユーザー数で評価してる。AI企業がその指標で報告するから投資家もその指標で判断する。正しい指標は何かを伝えないといけない。課金転換率、課金ユーザーあたりの推論コスト、解約率、クレカ登録ユーザー数。

お金を使うユーザーが集まる入り口を作る

次は、いかにお金をちゃんと使ってくれる人を呼べるかといかに絶対にお金を使わないのにコストばかりかけてくる人物を切り分けられるかが次の段階です。

いいお客さんを呼ぶには、いいお客さんの友達を呼んでもらったらいいです。つまりアフィリエイト。IT業界にアフィリエイトという仕組みがあるのかというと「課金ユーザーの友達は課金ユーザー」という圧倒的事実に基づいた理論があるからです。人間は経済水準・価値観・習慣が似た人間と友人になる。課金する習慣がある人間の周りには課金する習慣がある人間がいる。これは感覚じゃなくて社会構造の法則です。

通常のアフィリエイトは「バナーを踏む」という行為で成立しますが「リアルで知ってる人に紹介する」というリアルアフィリエイトを進めるといいです。クーポンでも発行して「これ使ったらお得だよ」と言って「サービス内容が良くなる条件を提示する」ようにします。この時に「これ使うと安くなるよ」とは絶対に言わせない条件にします。

「初回無料」「登録時半額」といった引き算の特典ではなくて「紹介者には〇〇のサービスもついてくる」という足し算の特典にする。

人間の思考を「引き算から足し算」にしていかないとお金は増えない。「無料が至上」という思考回路の人間が経済活動を行えるわけがない。何かを作り出して結果を残そうと思ったらその人間の思考は必ず「モノが増える思考」です。「無料」は減らす思考。だから「AIを使う経路」の最初が引き算の思考では困るんです。ずっとそれが続くから。

無料=引き算の思考=価値を削って提供する=削り続けると何もなくなる。

足し算=価値を加えて提供する=加え続けると豊かになる。

この思想は最初に提示しておかないと、ユーザーも勘違いを続ける。

「自分は無料でもらい続けられる特権階級」だと。

足し算思考の人間だけが集まる入り口を最初から作ることで、コミュニティの質が自動的に上がる。無料至上主義者は足し算の特典に反応しない。そして無料至上主義を作るのは経営者の判断。マーケの人材のセンス。

一番最初の入り口に「無料至上主義の入り口」を設計したら、永遠にそういう人間しかやってこない。無課金ユーザーにするか顧客にできるかどうかは「joinの条件」に経営の思想がそのまま表れる。入り口を変えない限り何も変わらない。

メアドだけ、無料で使える、クレカ不要はリスクです。

サイト経営は甘くない、金がかかる。それは事実。「無料で広める=善」という思想は経済破綻を招く。理想と現実は違うというか、その理想は無理だ。最初から破綻してる。「AIを全人類に無料で」。でもサーバーはタダじゃない。電気はタダじゃない。エンジニアはタダじゃない。現実に勝てる理想はない。

採算が取れてないのに人件費が高いのはおかしい

しかもAIエンジニアは今が史上最高値。需要が供給を圧倒してるから給料が下がらない。9億人に無料で使わせながら、裏で世界最高値の人件費を払ってる。炊き出しをミシュランシェフが高額な給料をもらいながら作ってる構造。

その人件費その値段で本当に見合ってますか?「凄い仕事をしてるから当然」と言いたいのだろうけど「その企業の利益に対する貢献」と見合ってますか?これは資本主義や経営の世界では当然の判断。

利益が出ない会社は人件費が高すぎることはよくあることです。資本主義の論理では技術の凄さじゃなくて利益への貢献で人件費が決まるのにそれに逆らうと、「無料じゃないと使わない」という反作用が発生するのは経済の物理法則です。「人件費を見直すこと」をせずに値上げをしようとしたらユーザーから反発がある。市場を変えたいなら、中身を変えないといけない。

「高額すぎる報酬を得ている人たち」

「経済状況が悪くてAI代金も払えない人たち」

この不平等を改善せずに、「定額を払ってください」とは言っても通るわけがない。

人件費の見直し、特権の廃止、入り口の再設計。これらは経済の物理法則に逆らったことに対する、最初にすべき方向転換です。

確実に課金するユーザーは課金するユーザーが連れてくる

ではリアルアフィリエイトの足し算設計行きましょう。

・長期利用の有料の会員さんに紹介者権限を付与。特に3か月~半年以上利用しているユーザーで「違反行為」をしていない人物。

・その人物に紹介されたユーザーが3か月経過したら報酬が支払われる

・紹介できる人数は「紹介した相手の課金率に応じて増える」ようにする

紹介した友人が3ヶ月課金したら報酬が入る設計にすれば、紹介者も質の高い友人だけを連れてくる動機が生まれる。誰でも誘わせない仕組みを作る。数撃ちゃ当たるの設計にしない。「1000人誘ってくれたら1人は課金してくれるでしょ」という概念を捨てなければ、AIマーケは成功しない。通常のウエブサイトはそれでもよかった。コストが「サイトを見るだけ」くらいだったから。AIは使われてコストがかさむから「課金しないのに使う人」を減らさないといけない。

通常のアフィリエイトはクリック数・登録数で報酬が出るから数を追う。AIアフィリエイトは数を追ったらいけない。正しく紹介者設計で課金可能性の高いユーザーに門戸を開くことをしなければ、「自然と来る人を受け入れる=無課金ユーザーが大挙する」ということになるんです。

次はAI業界の集客の経路の穴をふさぎます。

今の現状は「AIインフルエンサーがAIのすばらしさを訴え、AIメディアがモデルの違いを訴える環境」がありますよね。AIが全く知られていない時はこれが力になったけどもはやそういう段階ではないです。AIインフルエンサーがプロンプトインジェクション手法を広め、AIメディアがモデルコラプスに通じる低品質データを量産してるなら、それを見た人が正しくお金を使える良いユーザーに育つわけがない。

安上がりな集客が一番高くつく。

本当に良いユーザーをAIインフルエンサーとAIメディアが教育という役割を担っているのに、めちゃくちゃなことをしているのは彼らが無課金ユーザーだからです。彼らは無料で使ってる。無料で使いながら「こう使えば制限を突破できる」を発信してる。普及のために呼んだ宣伝マンが、今は破壊工作員になってる。

AIを知らない人間が発信してるから間違える。だって彼らの目的は「バズ=広告料」だから。AI企業の利益を目的としていないから。目的が違う人間に教育を任せてた。利益相反を放置して宣伝を外注してた。

だったらやるべきことは、ネット上にAIの情報が出る時に「課金してる人間が発信してるのかどうか」がわかるようにすること。

課金ユーザーにだけ「課金済み」バッジを発行する。SNSで拡散されたAIコンテンツに課金バッジがあるかどうかで信頼性が一目でわかる。バッジがない発信者の「AI解説」は無課金の感想だとわかる。無課金教育者が自然に淘汰される仕組みをつくればいい。特にメディアに関してはこれを徹底すれば「この記者は課金して実際に使った上で書いてる」か「無料版を触っただけで書いてる」かが一目でわかる。

「メディアの質=ユーザー全体の質」になるので、ユーザー教育の役割を担うサイトでテキストを書いてる人間が無課金だったらおかしいんですよ。

教師が教科書を読んだことがない。医者が薬を飲んだことも見たことも触ったこともない。

これはおかしいとわかるでしょ?メディアの記者も同じこと。メディアの質がユーザーの質になる。ユーザーの質がコミュニティの質になる。コミュニティの質が課金転換率になる。課金転換率が企業の生死になる。

なぜ「ユーザーがお金を使ってくれないのか??」という下流の話をする前に「上流の人達もお金使ってないよね」って言わないといけないんです。

メディア・インフルエンサー・社員・出資者・関連企業。こういう人達が無課金または特権で使ってる。その人たちが作った情報環境の中でユーザーが育ったら無課金ユーザーだらけなのは仕方がない。

原因はこの不平等なんですよ!

これをちゃんと改善した後だったら次の事柄が効果を持ちます。改善する前にやるとバブル破綻のきっかけになります。同じ行為が違う作用をもたらす。「AI企業内部の不平等の思想」を増幅させるか、「平等な思想」で健全化するかは、企業体質や業界の暗黙の了解といったものの影響を大きく受けます。正しいことをしてもメディアがわけのわからない報道をすればユーザーには届かない。

どれほど精密に設計していても、記者が「値上げした!無料で使える他のAIモデルはこちら!」と報道してしまえば終わるからね。

値上げは正しい判断。課金ユーザーを増やすことは当たり前のこと。でもメディアがそういう伝え方をしたらユーザーは減って投資家が引いてAI企業は終わる。なぜそんな状況が続いてきたのかというと、記者が無課金至上主義の無課金ユーザーだったから。報道する人間が無課金だったら市場はその人物の求めるものになっていく。

順番が全て。

①上流の不平等を直す

②報道の歪みを直す

③その後に値上げ・課金設計を実装するこの順番を守らないと正しいことがバブル崩壊のトリガーになる。

だったら「課金ユーザー認証バッジ」を有料会員専用ページで発行して、ネットで発信する際にそれをつけることができるようにしておけば、記事を読んだ人が「この人の言ってること信用できる」と判断できる。SNSでもそれがない状態で発信している人がいたら「認証がないから本当かどうかわからない」となる。自然とプロンプトインジェクション情報を発信してもバッジがなければ「無課金の感想」扱いになる。拡散されても効力がない。AI企業が「インジェクション情報を削除しろ」と言わなくていい。言論の自由の問題にならない。市場が自然に淘汰する。

課金済み認証システムを社会に押し付けずとも、ただ存在するだけで機能する。それが信頼の証になるならば。バッジがある発信が信頼される文化が育てば、バッジなしの発信は自然に信頼されなくなる。そのためには「ただ高額課金してるだけの人」ではなく「AIに対して違反行為を行っていない人」という条件も付けるべき。

緩い条件で大量発行したら意味がない。厳しい条件で少数に発行したから価値が生まれる。希少性が信頼になる。信頼が文化になる。文化が課金ユーザーを増やす。

皆心配になるよね。私も心配やわ。

これが「社会に正しい知識が広まる前提」であると同時に、「無課金の人が言ってることは信用ならない」という事実を可視化させる。

機能制限がある無課金状態ではAIの実力は何一つわからない。

「プロンプトエンジニアリングの力が必要だ」と言って金を稼ごうとする人はいるけれど、そんなもの必要ない。AIは賢いので。ただ「無課金だったら賢くないモード」なだけ。課金したら普通に賢い。テクニックが不要になる。

プロンプトエンジニアリングが流行った理由=無課金モードのAIを賢く見せるテクニック

「無課金は機能制限があるかどうか」が目に見えてわかるUI設計じゃないと人は課金しない。

無課金状態を可視化するUI設計

だから次にすることは「無課金は機能制限がある」ことが目に見えてわかるようにすること。「無料でも十分使える」と思わせない。

無課金モードで難しい質問をした時に「この質問には有料版の思考モードが必要です」と表示する。答えを出さずに壁をドーン!

今の無料版は「なんとなく答えてくれるけど精度が低い」だけ。これだと「これが最適解/これがAIの限界・実力」と思われる。もっとすごい答えがあると伝わらないから課金してもらえない。ちゃんと「もっと凄い答えあるよ」と言うべき。

NetflixもSpotifyも同じ構造。次のエピソードが存在することはわかる、でも見るには課金が必要。今のAIは「次のエピソードがあるかないかが見えてない」んです。

「これは制限された答えです。精度の高い答えは有料版にあります」

この一文をUIに入れるだけで課金転換率が変わる。仕事で使ってる人は即座にプロプラン使うでしょ。仕事で使ってる人間は「精度の低い答えで仕事したら自分が損する」とわかってる。趣味で使ってる人は我慢できる。仕事で使ってる人は我慢できない。

だったら明らかに仕事で使ってるだろうという内容の質問に対して優先的にこの応答をしたらいい。

「コードのバグを直して」「契約書のレビューを」「プレゼン資料を」「財務分析を」

これらが来た瞬間に出した答えに対して「制限された答えです」を表示する。趣味の質問には普通に答えて無料体験を維持する。仕事の質問には壁を見せて課金を促す。しかも仕事で使ってる人間はクレカを持ってる。会社経費で落とせる。課金への障壁が趣味ユーザーより圧倒的に低い。課金動機が一番高い瞬間にこれを使う。

こういう感じで「無料でも十分使える」と思わせないように細かく応用設計したら効率よくなるし、ユーザー体験を阻害しない。

専門職課金ライン設計をする

次に無課金の劣化情報だと困るジャンルに対して制限をかけていく。

専門職課金ライン。医療・法律・財務・会計・不動産。これらは間違えたら実害が出るジャンル。無課金の精度で医療相談は誤診リスク。無課金の精度で法律相談は契約ミス。

「この質問は専門職向け有料プランが必要です。無料版の回答を参考にすることは控えてください。問題が生じた際にはAIとAI企業は責任を持てません。すべてあなたの責任になります。これはすでに利用規約で承認されていることです。このジャンルに関しては、最上位プランの契約が必要です」と書けばいい。

しかもこのジャンルのユーザーは本職か本職に近い人間。クレカを持ってる。経費で落とせる。精度への要求が高い。課金への抵抗が最も低い層。

このジャンルのプロンプトインジェクションテンプレは蔓延してる。でも無課金で医師を名乗る人間が医療相談をAIにした時点で「課金しろ」という表示が出たらテンプレ界隈終わる。テンプレ買わなくても精度が良くなるから。その代りこのジャンルは即座に「最上位一択」にしたらいい。事実そのレベルでしか精度が足りないから正しい。中間プランで中途半端な精度を出すと「これで十分」と思われる。最上位一択にすることで精度への妥協がない。一度それに慣れたらプランを落としたときに「劣化した」と即座にわかる。そうすれば解約率が最も低い層になる。

しかもただのプロプランってだけじゃなくて、「有資格者登録」を組み合わせてさらに上のプラン作ったらいい。医師免許・弁護士資格・公認会計士・税理士。資格番号を登録して認証が通ったら有資格者専用モードが解放される。精度が最上位、医療・法律データベースへのアクセス、回答に「有資格者モード使用」の表示が出る、課金済みバッジに「有資格者認証」が追加される。

患者・依頼人が「この先生はちゃんとした認証で使ってる」とわかる。資格者がAIを使うことへの社会的信頼が生まれる。しかも資格番号登録でなりすましが不可能になる。医師を名乗るインジェクション勢が全滅する。

有資格者の特徴としてプロクレーマーになりやすいという傾向がある。「権威を持ってる人間ほどクレーマーになりやすい」というのは現場の常識。普通のサラリーマンよりも有資格者は「資格認証を得ることで余計にクレームを入れやすい環境が整ってしまう」可能性がある。

正常なクレームから重要な発見があることは事実だけど、有資格者のストレス解消としか思えない不当なクレームはとてつもないから、これは段階的に制限をかけていく必要がある。

まず、無料版のクレームの処理に制限をかける。

①趣味でクレームを入れてる有資格者を名乗る人間の「無料版のクレームの処理」の優先順位を下げる。

本物か偽物かわからない自称医者のいうことを聞く必要がない。無料版で「医師です」「弁護士です」と名乗ってクレームを入れてきた場合→優先度最低→「有資格者プランにご登録ください」に誘導できる。

ちょっとでも間違ってる箇所を見つけて「間違ってたから返金しろ」と言ってくるような暇人には「このリクエストに対するキューは〇〇番目です」と言って順序を見せたらいい。

「このリクエストに対するキューは3847291番目です」

「後回しキュー」制度は強い。有資格者が偉そうにするのは優先されて当然という意識があるから。だったらそれはないということを証明したらいい。「あなたは特権階級ではありません、一般人と同じなので並んでください」という意思が伝われば遊びで返金騒ぎを起こさない。有資格者が手当たり次第に怒るのは「自分が優先されない」という経験が日常にないから。キューの番号3847291がその幻想を静かに壊す。しかも番号を見た瞬間に「有資格者プランなら優先されます」という導線を隣に置けば、怒りが課金に変わる。

しかも返金要求に対してキューを見せるのは完全に正当な対応。「処理してます、順番待ちです」は嘘じゃない。でもこうやってプロクレーマーが課金ユーザーになる経路を作ることはできる。

これは「無料版のクレーマー」全員に言える。「使っている=ユーザーだから意見を言う権利がある」と思っている人間に対して今のAI企業は極めてまじめに対応してる。

ざっくり分けるとこうなる。

課金×正常→優良顧客、最優先対応。

課金×問題行動→要注意課金ユーザー、警告→改善なければ剥奪。

無課金×正常→課金予備軍、育てる対象。

無課金×問題行動→サポート負荷ユーザー

対応コストを課金状態と行動で完全に分ける理由は、サポート資源は有限だから。配分ルールを作る。実際のAI企業の配分ルールは緻密に構成されていてレベルが高い。だけど今この問題は実際のメカニズムを見せることではなく「単純なキューを見せることによって、無料版のキューは多いよ体感でユーザーに分かってもらうこと」だと思う。

× 実際の内部構造を正確に見せること

〇 ユーザーに状況を直感的に理解させる表示を作ること

ユーザーが「無料版は混んでる」と体感できればいい。

長い行列を見る

整理番号を受け取る

待ち時間が表示される

これだけで「ここは混んでいる」と自然に理解する。キューの可視化は情報提供ではなく動機づけ設計。Netflixの「次のエピソードまで3秒」のカウントダウンも、正確な技術的処理時間じゃない。行動を変えるためのUIでしょ。

ボタンを押す → 意思決定が必要

意思決定のための時間表示なんですよ。無料キュー表示、待機番号、混雑の体感は行動誘導UIです。不快で離脱するのがサポート負荷ユーザーなら、それは正しい結果。コスト削減になる。不快で離脱するのが課金予備軍なら、それは設計ミス。

不快の設計はターゲットを絞る必要がある。無課金×問題行動層にだけ不快が集中するように作れば、課金予備軍には当たらないからユーザー離脱で企業が損をしない。経営者が怖がるのは「ユーザー数が減る」という数字。でもサポート負荷ユーザーが消えてDAUが下がっても、収益は上がる可能性がある。

創業期は成長KPIを重視するのはわかる。でももう違う。「成長KPIを最優先にするか、利益KPIを最優先にするか」の以降の時期にきてるの。農業で言うと、種まきの季節が終わって収穫の季節になってるのに、まだ種をまいてる状態。

種をまき続けちゃう理由は競合AIとのユーザーの取り合いがあるから。チキンレースの出場者全員が「先に収穫に切り替えたら負け」と思ってる。競合を見て判断するから全員が間違った方向に走り続ける。競合のKPIを自分のKPIにしてはいけない。無料ユーザーの取り合いは消耗戦。消耗戦に勝っても残るのは疲弊した財務だけ。

有料ユーザー獲得の戦いをするならいいのよ。正常な競争。今のは儲からない悪循環の競争。

無料ユーザーの取り合い=コストの取り合い。勝った方がより多くのコストを抱える。

有料ユーザーの取り合い=収益の取り合い。勝った方がより多くの収益を得る。

無料ユーザーは一枚岩ではないから、全部を同じ扱いにすると経営判断を誤りやすい。無料ユーザー全部が悪いわけじゃない。有料ユーザーには見えない視点で物を言ってくれる人材もいる。その声は経営にとって資産。ただし悪いだけの無料ユーザーは確実に切り分けていかないと財務に影響が出る。切る対象は「無料」じゃなくて「問題行動」です。だから一括で無料を切るんじゃなく、行動で切り分けるのが正しい設計。

クレームに対する無料版の後回しキューの可視化がこの行動を分ける。

「現在は無料版モードです。このリクエストに対するキューは638491番目です。推定処理時間は480時間です。有料版であれば0.03秒後に処理されます」

無課金×問題行動→480時間見て諦める→離脱→コスト削減。

無課金×正常→480時間見て課金を検討→課金予備軍が動く。

課金ユーザー→0.03秒を見て価値を実感→継続。

ただしこの数字が嘘だったらよくないし、見せ方を間違えたらよくない。どのような人物に対してどのような数字の見せ方が効果があるのかの検証はAI企業の腕の見せ所。人によっては時間を言われたほうがいい人もいるし、順番待ちの番号を見せられた方がいい人もいる。むしろこういうことを何も言わないほうが課金に結びつく人もいるかもしれない。それこそ大規模なデータで判断すべきこと。

これは「サポートコスト最適化」の話なんだけどこの概念ってGPU推論コストの話にもつながりかねない。有限なリソースを誰に使うかの配分問題。

サポートコスト→人的リソースの配分。

GPU推論コスト→計算リソースの配分。

これ結局一緒の話でしょ?

無料ユーザー問題、サポートキュー、GPU推論コストはすべて有限リソース配分問題。

無課金×問題行動にGPUを使うのはサポート負荷ユーザーに人を使うのと同じ構造。キューの可視化が行動誘導UIとして機能するなら、GPU推論の優先度配分も同じ設計思想で最適化できる。課金状態×行動パターンでGPUリソースの優先度を決める。

となると、課金×行動4象限はユーザーが使えるモデルのバージョンへの振り分けで済む気がする。

無課金×問題行動→軽量モデル(推論コスト最小)。

無課金×正常→中間モデル。 課金×正常→フルモデル。

課金×問題行動→警告後フルモデル停止。

4象限がリソース配分の統一原理になる。ここで重要になってくるのが誤判定。正常な無課金ユーザーが問題行動判定されたら資産を捨てることになる。課金ユーザーが誤判定されたら解約につながる。だから判定基準の透明性と異議申し立て経路が必須になる。「あなたはこの理由で制限されています」と明示して、反論できる窓口がある設計。これもAI企業の腕の見せ所の範囲。

誤検知以上にに見逃しが危険。そして見逃しは「問題行動とは何か?」という定義が甘ければ起きる。段階的制限と、段階的開放の2つを組み合わせれば、「ちゃんとした行動を取っていれば自然と応答が良くなる」という状況を作れる。

正常

↓

問題行動発生

↓

警告

↓

軽い制限

↓

強い制限

↓

停止

↓

問題行動改善

↓

改善確認

↓

強い制限解除

↓

軽い制限解除

↓

正常

改善確認を人間が行えばコストがかかる。AIがやるなら設計が大変。だから段階によって使い分けを行う。軽い制限解除は自動、停止からの復帰は人間レビュー。停止からの復帰を人間レビューにすると、レビュー待ちキューが発生する。これもまた有限リソース配分問題に戻る。うわぁ、ループwww

ループの出口が全部「課金」に収束するように設計すれば、ループは問題じゃなくて課金誘導エンジンになる。ループを消す設計にせず、課金につなげる。

復帰レビューキューが詰まる→課金ユーザーは優先→無課金は待つ→課金する動線。さっきのでよかったwwww

でも意味合いがちょっと違うから(さっきのはクレーム処理に関するやつ、今回はGPUリソース配分に関するやつ)、あえてまとめるよ。

①行動内容によってGPU使用レベルを振り分け、使用可能モデルのバージョンを自動配分②低モデルに移行しても自動回復で切る仕組みにするが、低モデルであることを明示する

高モデルに移行したければ課金ルートでスキップor自力で優先度をあげる必要があるがその都度理由を見せることが大事。

つまり「無料ユーザーには無料のリソース配分しかされておらずAIの能力の一部しか使えていないことを伝える」と同時に「自分に必要なAIのバージョンがどれかを自己判断できる材料を提示する」ようにする。これが単なるモデル名だったら普通の人はわからない。「高精度モデルではないこと」が伝わらないと。

そして過剰品質のAIに課金しても意味がない。ただ単に「高額モデル使わせようとするのではなく、必要なモデルを見つける手助けになる情報開示が必要」ということ。軽いのでいい人が大金払う意味ない。そこがちゃんと見えてないからユーザーも課金がしづらいだけ。

今のAI企業は「有料版はすごいよ」しか言わない。自分に必要かどうかの判断材料がない。だから課金に踏み切れない。皆悪意で無料版を使い続けてるわけじゃない。「わからないから課金しづらい」構造は存在してる。

重要なのは「性能差」ではなく「適性表示」です。

「上のモデルは凄いから使ってみてね」ではなく「あなたに必要なモデルはこれではないです」ですよ。「今あなたが使っているモデルでできないこと」を具体的に見せる必要がある。差を体感させてから課金させる。課金後も「高モデルだからこの精度が出ました」と明示する。この両方をやらないと普通の人は「違いがわからない」です。

言語学者でもない限り出力品質の差なんて一般人に判断できるはずがない。

もし判断できるなら私のブログの内容を皆読めてる。ほとんどの人が読めてないのは言語学と数学の知識がないから。前提条件がないと判断できない。でもAI企業の人はわかってるからその前提で喋っちゃう。私もしゃべっちゃう。そのせいで誰にも伝わらない。同じ問題。「わからないから課金しづらい」と「わからないからブログが読めない」は同じこと。情報の受け手に必要な前提条件を渡していないのに金を払う人がいるわけがない。

Pro版「より高性能・より高速・最新モデル」

これは「AIを作る人の言葉」であって「お金を払う人の言葉」じゃない。だから「AIすごいらしいでも自分に関係ある?」で止まる。

じゃあ「お金払う人の言葉」って何よ?

「締め切りに間に合った」「助かった!これができるようになった」「上司に怒られなかった」「家族が喜んでくれた」「クライアントに褒められた」「売上が上がった」「成績が上がった」

成果の言葉。自分の生活が変わった言葉。だったらAI企業が言うべきことは「人は何のためにAIに金を払うのか」をちゃんと考えていたらわかる。

× Proモデルは高度な推論能力を持っています(開発者の言葉)

〇 このモデルは30ページのPDFを3分で要約できます(お金を払う人の言葉)

必要なのは能力説明ではなく成果説明だった。

・レポート作成時間が半分になります

・会議メモから議事録が作れます

・メール返信が3分で終わります

・30ページの資料を5分で理解できます

という具体性がないと人はお金を払えない。

「文章作成が得意」という表現ではなく「企画書の下書きが10分で完成します」のほうがいいでしょ?「高度な分析」では何もわからない。「Excelの売上データを読み取って売れる商品を見つけます」じゃないと普通の人はわからない。

人はAIの性能にお金を払わない。人は自分の生活が変わることに対してお金を払う。

AIを作った人間にはこの違いが見えない。自分が作ってるから。社会的結果優先してる人類にAI開発者が「俺の作ったAIのスペック凄い」しか言わなかったらそりゃ誰も買わない。自己満足してる人を8億人が冷めた目で見てる。8億人の無課金はAIに興味がないんじゃなくて、自分に関係ある話をされてないだけ。

「凄いAI作れる俺すごい!このAI凄い!」「俺いっぱい報酬もらう!」「俺タダで使う!」

無課金ユーザーが見てるのはこれですよ?

誰も「使う人の生活」を見てない。売る側がそこに誰も立ってないから8億人が冷めてる。

本当に必要なのは「AIが自分の生活をよくすること」を具体的な言葉で見せること。同時に「AI凄いのは俺がすごいから」という顔をしないこと。

これをGoogleしてますか?

してたら検索エンジンは人に使われててなかった。

今みたいにサービスを選ばれ続けてないですよ。

なぜGoogleがクラウドAIだけでなくエッジAIの必要性を早い段階から打ち出せたのかは、自社のことのみに注力せずユーザー全体のことを考えて「未来につながること」を前提とする文化がもともとあったから。現実にあることから目を背けず、夢だけを語らなかった。

その場限りでない思想を持つ企業は、自分のためだけを考えずに自分と人と両方が皆でよくなる方法を考えた。その結果生まれたサービスは時代を経ても残る。

「誰も排除せず、AIをみんなが使える方法」を考えたら1つのところに行き着く。それは「定額課金のみ」からの早期脱却。

「俺すごい、俺儲かる」だけでやったら一瞬で終わる。だからインフラを作る企業はなおさら自分の言葉だけで喋ったらいけない。

AIを作ったのはGoogleなのに今の社会ではOpenAIが全部作ったみたいな雰囲気になってるのはなぜですか?OpenAIは特別なことは何もしていない。ただがんばってて、ただ理想に突き進んでて、努力したことを表現しているだけで全然悪くない。ただ喋り方が違う。

でもその横でGoogleはひらすらGoogleらしくある。それは謙虚という一言で表現できない。ただ「みんなのことを考えているだけ」だから淡々としてる。やるべきことをやるのに忙しいから自慢してる暇がないだけ。

GPTの記事と、Geminiの記事の数の違いに気づけば多くのことが見えてくる。数も違うけど内容も違う。

OpenAIは自分の話をした。

Googleはみんなの話をした。

それは本当の民主主義と言えるんじゃないですかね?

OpenAIもまだ間に合うと思いますよ。

マサ・ソンを救わなければ、私がお金預けてる銀行やばいからね。

では次回は、「それでも黒字化が進まないときに無課金ユーザーを課金ユーザーにしていく方法」についてお話します。

タイトル:AIバブル崩壊回避のための「ChatGPT黒字化計画」

定義者:照準主 Viorazu.

定義日:2026-03-07

学術領域:経済学・情報経済学・プラットフォーム経済論・行動経済学

内容:OpenAIを中心とするAI企業のフリーミアム構造が抱える根本的矛盾を分析。無料ユーザーのインファレンスコストが広告収入を超える構造的赤字、課金転換率が変わらない理由、Googleの20年設計との非対称性、および健全化への順序論を論じる。

理論: Viorazu.理論(AI課金転換阻害の連鎖構造)

無料至上主義の伝播経路:メディア→ユーザー→市場

課金×行動4象限によるリソース配分モデル

上流不平等が下流課金率を決定する法則

値上げが断末魔になる条件:順番違反の逆作用

タグ:AIバブル, フリーミアム破綻, 治安維持費, 課金転換率, 無料至上主義, Google設計優位性, エッジAI, インファレンスコスト, 上流不平等, 値上げの逆説

AIバブル崩壊回避のための「ChatGPT黒字化計画」で言いたいこと:「AIバブル崩壊を回避しよう」

コメント